LM Studio 0.3.23

📣 ICYMI: LM Studio が業務利用で無料になりました!詳細はこちら https://lmstudio.dokyumento.jp/blog/free-for-work

LM Studio 0.3.23 が安定版としてリリースされました。今回のビルドは、信頼性の向上、低スペックデバイスでのパフォーマンス、およびいくつかのバグ修正に焦点を当てています。

チャットでのツール呼び出しの信頼性を向上 openai/gpt-oss

ツール名がモデルに送信される前に一貫してフォーマットされるようになりました。以前は、ツール名にスペースが含まれていると gpt-oss が混乱し、ツール呼び出しに失敗することがありました。ツール名は now snake_case に変換されます。

さらに、チャットでの解析エラーにつながる可能性があったいくつかの解析バグを修正しました。ツール呼び出しの信頼性が大幅に向上したことに気づくかもしれません。

Chat Completions エンドポイントを使用した gpt-oss からの推論コンテンツ

これはバージョン 0.3.22 と比較した動作の変更点です。

message.contentには、推論コンテンツや<think>タグは含まれなくなります。- 推論は now

choices.message.reasoning(非ストリーミング) およびchoices.delta.reasoning(ストリーミング) に含まれます。 - これは

o3-miniの動作と一致します。

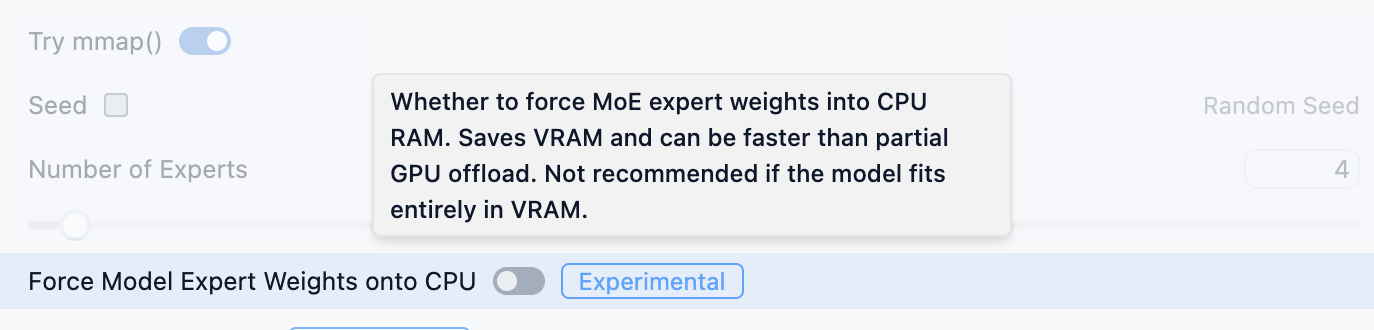

MoE エキスパートウェイトを CPU または GPU に強制する

このバージョンでは、すべての MoE エキスパートウェイトを CPU または GPU (デフォルト) に配置するための高度なモデルロード設定を追加しました。

CPU で MoE エキスパートウェイトを強制するにはオンにします。VRAM が少ないマシンで試してください。

モデル全体を GPU 専用メモリにオフロードするのに十分な VRAM がない場合に役立ちます。その場合は、高度なロード設定で「Force Model Expert Weights onto CPU」オプションをオンにしてみてください。

モデル全体を GPU メモリにオフロードできる場合は、エキスパートウェイトも GPU に配置したままにしておく方が良いです (これがデフォルトのオプションです)。

これは、llama.cpp の --n-cpu-moe と同じ基盤技術を利用しています。

永続的なモデルごとの設定を設定できることを思い出してください。詳細については、ドキュメントを参照してください。

LM Studio 0.3.23 - 完全リリースノート

アプリ内アップデート、または https://lmstudio.dokyumento.jp/download からアップグレードしてください。

ビルド 3

- [llama.cpp][MoE] 高度なロード設定の「Force Model Expert Weights onto CPU」を介して、エキスパートウェイトを CPU/GPU RAM にオフロードする機能を追加

- ツール名がモデルに提供される前に正規化されます (スペース、特殊文字を置換)

ビルド 2

- スタッフピックモデルをダウンロードする際に、「Complete Download」ボタンが機能しない場合がある問題を修正

- 拡張パック (Harmony など) の「Fix」ボタンが機能しない問題を修正

- 特定のツールを含むリクエストを

/v1/chat/completionsに送信した際の「Cannot read properties of undefined (reading 'properties')」エラーを修正 - Harmony を自動更新する際の

Error: EPERM: operation not permitted, unlinkエラーを修正

ビルド 1

- チャットでのツール呼び出しの信頼性を大幅に向上させるバグ修正

- 一部の古い会話がアプリでロードされないバグを修正

- OpenAI 互換 API を介して非ストリーミングモードで使用した場合にツール呼び出しが失敗することがあったバグを修正

- モデルが

v1/chat/completionsで思考タグを出力しない問題を修正- gpt-oss の場合

message.contentには、推論コンテンツまたは特殊タグは含まれません- これは

o3-miniの動作と一致します。 - 推論コンテンツは

choices.message.reasoning(stream=false) およびchoices.delta.reasoning(stream=true) に含まれます

- gpt-oss の場合

- AMD+NVIDIA GPU を搭載したマシンでアプリの機能に問題を引き起こしていた「TypeError: Invalid Version」エラーを修正

- MCP プラグインのチップ名がユーザーモードでレンダリングされないバグを修正

- クリック時に検索結果がリフレッシュされるバグを修正

リソース

- LM Studio のダウンロード: lmstudio.ai/download

- バグ報告: lmstudio-bug-tracker

- X / Twitter: @lmstudio

- Discord:LM Studioコミュニティ